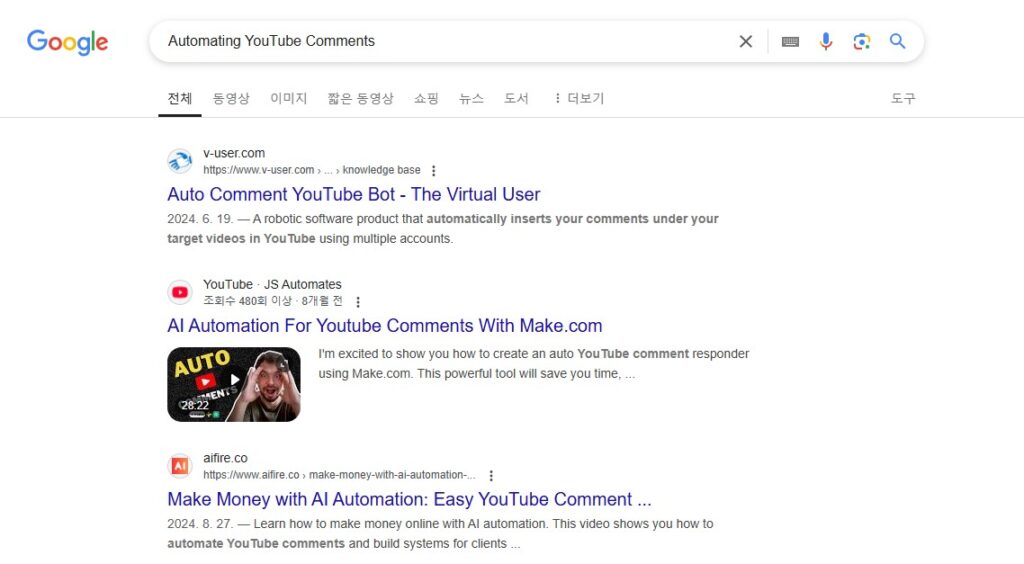

يُشكل استخدام روبوتات التعليقات لتضليل الرأي العام مشكلة اجتماعية متزايدة. تستخدم روبوتات التعليقات تقنيات الذكاء الاصطناعي والبرامج الآلية لإنشاء عدد كبير من التعليقات أو نشر آراء محددة. ومع ذلك، تزداد المخاوف من أنه إذا تم استخدام هذه الروبوتات بشكل خبيث، فقد تؤدي إلى تحريف الرأي العام أو خلق روايات مضللة حول مواضيع معينة.

خلال انتخابات رئيس مجلس النواب في تكساس بالولايات المتحدة، تم اكتشاف أن الروبوتات الآلية كانت تنشئ كميات كبيرة من التعليقات التي تنتقد مرشحًا معينًا وتدعم المرشح المنافس. كشفت التحليلات أن جميع هذه التعليقات تم إنشاؤها بشكل منظم من قبل حسابات آلية. يُعتبر هذا الحادث مثالاً بارزًا على كيفية استغلال وسائل التواصل الاجتماعي للتلاعب بالرأي العام.

بالإضافة إلى ذلك، تبين أن روسيا كانت تقوم بحملة باستخدام أقسام التعليقات في وسائل إعلام مختلفة في الولايات المتحدة والمملكة المتحدة لنشر نظريات المؤامرة المؤيدة لترامب والروايات المؤيدة للكرملين. وقد حدد الباحثون 194 حسابًا مشبوهًا كانت تنشر رسائل متسقة بهدف التلاعب بالرأي العام. يُبرز هذا الحادث مرة أخرى إمكانية استخدام روبوتات التعليقات لأغراض سياسية.

في اسكتلندا، خلال مشاورة حكومية، حاولت الروبوتات الآلية التلاعب بآراء الجمهور حول قضايا رئيسية. وقد تم التعرف على أنماط حيث تم تقديم عشرات الردود في فترة قصيرة من نفس عنوان IP، مما يظهر خطر تشويه النقاشات حول قضايا معينة.

وفي استجابة لذلك، تعمل الدول الرئيسية في جميع أنحاء العالم على وضع أطر قانونية وإجراءات تنظيمية لمواجهة مشكلة التلاعب بالرأي العام بواسطة روبوتات التعليقات. تتخذ الولايات المتحدة إجراءات من خلال وزارة العدل ومركز المشاركة العالمية (GEC) التابع لوزارة الخارجية لمنع انتشار المعلومات المضللة الأجنبية. كما نفذ الاتحاد الأوروبي (EU) قانون الخدمات الرقمية (DSA) لتعزيز اللوائح التي تمنع انتشار المحتويات غير القانونية والمعلومات المضللة. بالإضافة إلى ذلك، أنشأت سنغافورة قانون حماية الحقائق الكاذبة والتلاعب عبر الإنترنت (POFMA) الذي يوفر السلطة القانونية لفرض حذف وتصحيح المعلومات الكاذبة.

يحذر الخبراء من أن مشكلة التلاعب بالرأي العام بواسطة روبوتات التعليقات من المحتمل أن تزداد سوءًا. ولا سيما مع تطور تقنيات الذكاء الاصطناعي، التي تمكن التعليقات الآلية من فهم السياق بدقة وإنشاء جمل طبيعية، مما يجعل اكتشافها أكثر صعوبة.

لذلك، يجب على مشغلي المنصات والحكومات تعزيز أنظمة الكشف التكنولوجي لمنع التلاعب بالرأي العام بواسطة روبوتات التعليقات. كما ينبغي على المستخدمين تعزيز تعليمهم في مجال الوعي الإعلامي لتحليل مصادر المعلومات عبر الإنترنت بشكل نقدي. إن التلاعب بالرأي العام بواسطة روبوتات التعليقات يُعتبر مشكلة خطيرة تؤدي إلى تقويض الثقة الاجتماعية، مما يتطلب اتخاذ إجراءات قوية لمواجهتها.