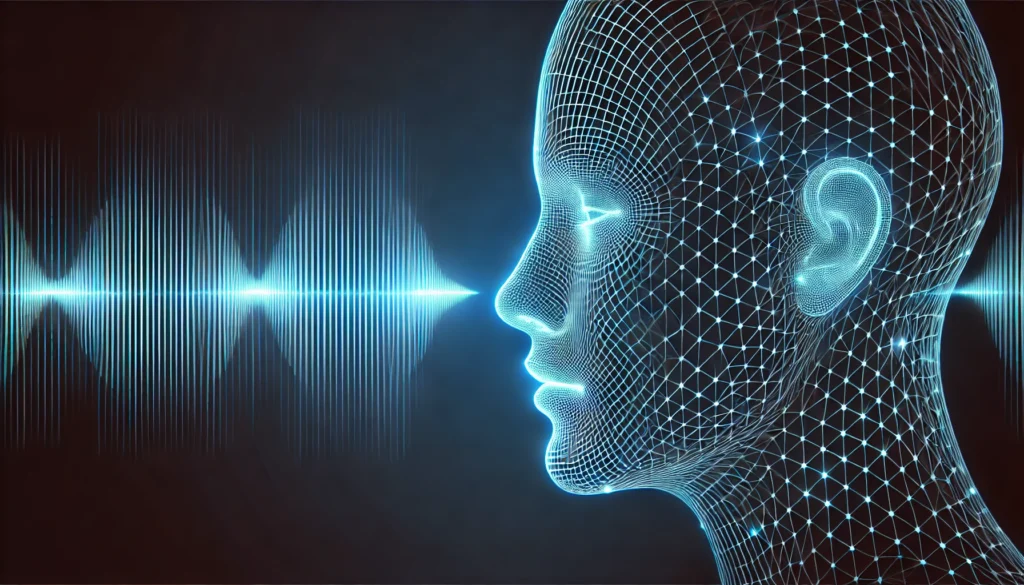

مع التطور الحديث لتكنولوجيا الذكاء الاصطناعي (AI)، أصبحت تقنية استنساخ الصوت حقيقة واقعة، مما يثير المخاوف بشأن إساءة استخدامها في جرائم الاحتيال الصوتي (Voice Phishing). يمكن لاستنساخ الصوت بالذكاء الاصطناعي تقليد صوت شخص معين بدقة باستخدام بضع ثوانٍ فقط من عينات الصوت، بل ويمكنه حتى إعادة إنتاج التعبيرات العاطفية. وعلى الرغم من أن هذه التقنية تم تطويرها في الأصل لتطبيقات إيجابية مثل المساعدات الصوتية وسرد الكتب الصوتية، إلا أن حالات استخدامها في الاحتيال المالي وانتحال الهوية آخذة في الازدياد في السنوات الأخيرة.

لطالما كان الاحتيال الصوتي مشكلة اجتماعية خطيرة. ولكن مع تزايد انتشار تقنية استنساخ الصوت بالذكاء الاصطناعي، من المتوقع أن تصبح الهجمات أكثر تطورًا وأن يزداد نطاق الأضرار. في الماضي، كان المحتالون يتصلون بالضحايا مباشرة لخداعهم باستخدام تقنيات الهندسة الاجتماعية. أما الآن، فيمكن للذكاء الاصطناعي تكرار أصوات أفراد عائلة الضحية أو أصدقائه، مما يجعل تنفيذ عمليات الاحتيال أكثر إقناعًا. بمعنى آخر، تمت إضافة تقنيات الهندسة البيومترية إلى هجمات الاحتيال الصوتي.

وفقًا لتقرير نشرته صحيفة نيويورك بوست في أكتوبر الماضي، تم خداع رجل مسن في كاليفورنيا، الولايات المتحدة، وخسر 25,000 دولار بعد أن تم تضليله بصوت مستنسخ بالذكاء الاصطناعي يُشبه صوت ابنه. قام المحتال باختلاق حالة طارئة، مدعيًا أن ابن الضحية تعرض لحادث مروري ويحتاج إلى كفالة مالية، مما دفع الضحية إلى تحويل الأموال.

لا يقتصر الاحتيال الصوتي القائم على استنساخ الصوت بالذكاء الاصطناعي على الاحتيال المالي فحسب، بل يشكل أيضًا تهديدًا خطيرًا لأمن الشركات. ففي عام 2019، تم خداع الرئيس التنفيذي لشركة طاقة بريطانية، حيث قام بتحويل 220,000 يورو بعد أن تم تضليله بصوت مستنسخ بالذكاء الاصطناعي يحاكي صوت الرئيس التنفيذي لشركة المقر الرئيسي. استخدم المحتال الذكاء الاصطناعي لجعل الصوت يبدو كأنه أمر حقيقي من الرئيس التنفيذي الفعلي، مما أدى إلى خسائر مالية للشركة. علاوة على ذلك، لا تقتصر هذه الهجمات على الاحتيال المالي فقط، بل قد تؤدي أيضًا إلى التجسس الصناعي وتسريب الأسرار التقنية، مما يجعلها ذات خطورة عالية.

للحد من مخاطر الجرائم التي تجمع بين استنساخ الصوت بالذكاء الاصطناعي والاحتيال الصوتي، يجب اتخاذ تدابير وقائية على المستويين الفردي والمؤسسي. يجب على الأفراد وضع رموز سرية مع أفراد الأسرة أو الأصدقاء المقربين لاستخدامها في حالات الطوارئ، والتأكد دائمًا من أي طلبات مالية غير متوقعة من خلال الاتصال المباشر بالشخص المعني. بالإضافة إلى ذلك، من الضروري تجنب مشاركة المحتوى الصوتي أو المرئي الشخصي بشكل مفرط على وسائل التواصل الاجتماعي، حيث يمكن استخراج بيانات التدريب الخاصة بالذكاء الاصطناعي بسهولة من مقاطع الفيديو والصوت المتاحة للعامة.

يجب على الشركات والمؤسسات المالية تعزيز إجراءات الأمان متعددة الطبقات لأنظمة المصادقة الصوتية، وتعزيز المراقبة في الوقت الفعلي للمعاملات المالية المشبوهة. كما ينبغي أن تنظم الشركات تدريبات لموظفيها حول هجمات الاحتيال الصوتي باستخدام الأصوات المستنسخة بالذكاء الاصطناعي، لمساعدتهم على التعرف على هذه الهجمات والاستجابة لها بشكل فعال.

إن تطور تقنية استنساخ الصوت بالذكاء الاصطناعي يحمل إمكانات كبيرة لتحسين حياتنا اليومية، لكنه في الوقت نفسه يفتح الباب أمام أشكال جديدة وأكثر قوة من الجرائم الإلكترونية. لذا، أصبح من الضروري رفع مستوى الوعي الاجتماعي واتخاذ تدابير وقائية أكثر من أي وقت مضى. ومع استمرار تطور تكنولوجيا الذكاء الاصطناعي بسرعة، تتزايد المخاطر المرتبطة بها. ولذلك، يجب على الأفراد والشركات على حد سواء البقاء يقظين والعمل على تنفيذ استراتيجيات فعالة لمواجهة هذه التهديدات الناشئة.