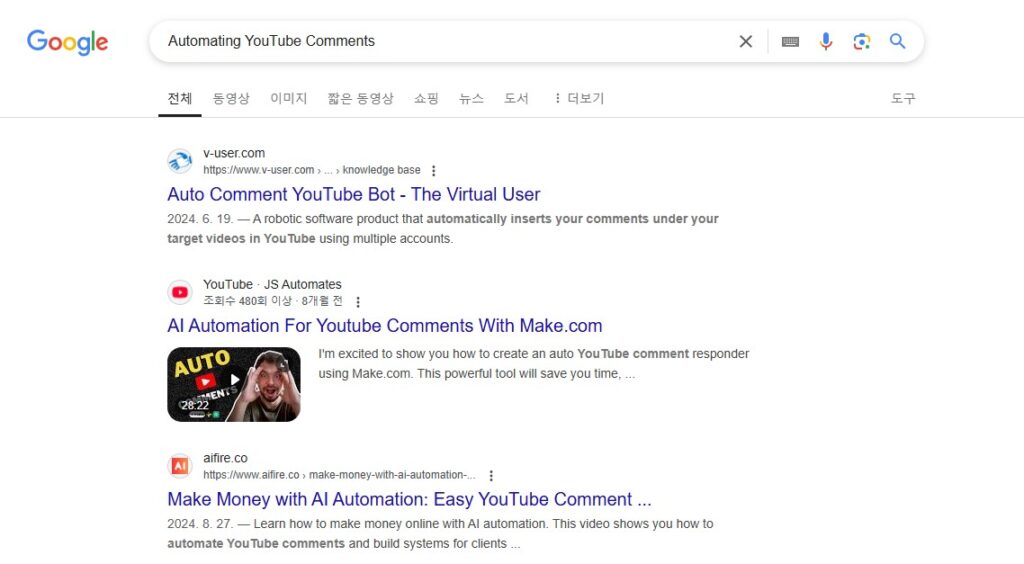

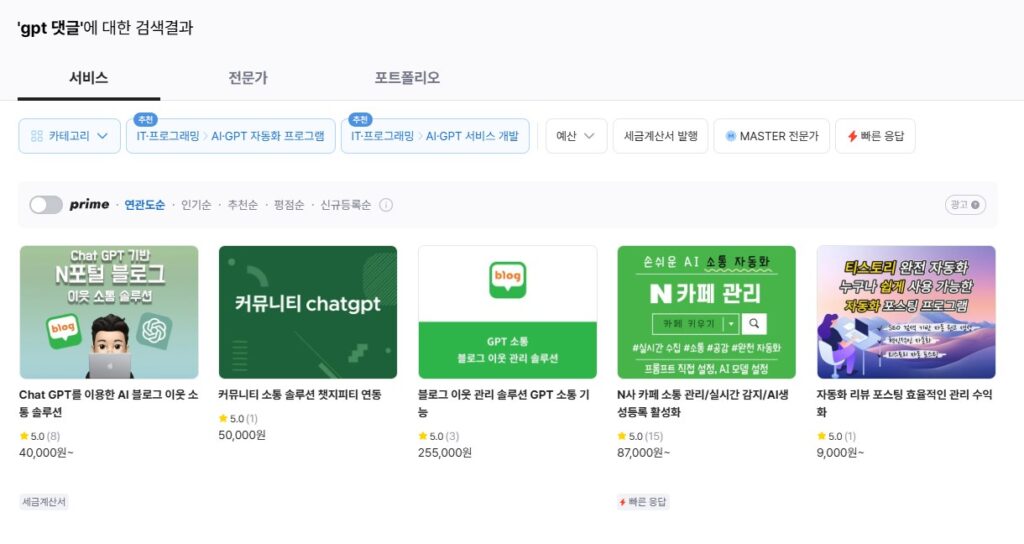

최근 댓글 로봇을 이용한 여론 호도가 사회적 문제로 떠오르고 있다. 댓글 로봇은 인공지능 및 자동화 프로그램을 통해 대량의 댓글을 작성하거나 특정 의견을 확산시키기 위해 사용되는 기술이다. 그러나 이러한 댓글 로봇이 악의적으로 활용될 경우, 대중의 의견을 왜곡하거나 특정 주제에 대해 잘못된 여론을 형성할 수 있다는 우려가 제기되고 있다.

미국 텍사스 하원의장 선거 기간 동안 자동화된 봇들이 특정 후보를 비난하고 상대 후보를 지지하는 내용을 대량으로 작성하는 사건이 발생했다. 데이터 분석 결과, 이들 댓글은 모두 자동화된 계정들에 의해 조직적으로 작성된 것으로 밝혀졌다. 이 사건은 소셜 미디어를 이용한 여론 조작의 심각성을 드러낸 대표적인 사례로 꼽힌다.

또한, 러시아는 미국과 영국의 여러 매체의 댓글 섹션을 이용해 친트럼프 음모론과 친크렘린 주장을 퍼뜨리는 캠페인을 벌인 것이 확인되었다. 연구자들은 194개의 비정상적인 계정을 식별하였으며, 자동화된 계정들이 일관된 메시지를 퍼뜨리며 여론을 호도하려 했다는 사실이 드러났다. 이는 댓글 로봇이 정치적 목적을 위해 사용될 수 있다는 경고를 다시 한번 환기시킨다.

스코틀랜드 정부 공청회에서는 자동화된 봇들이 주요 이슈에 대한 의견을 조작하려는 시도가 확인되었다. 동일한 IP 주소에서 수십 개의 응답이 짧은 시간 내에 제출되는 등의 패턴이 발견되었으며, 특정 사안을 둘러싼 논의가 왜곡될 수 있는 위험성을 보여주었다.

이에 해외 주요 국가들은 댓글 로봇을 통한 여론 조작 문제에 적극적으로 대응하기 위해 법 제정과 규제 방안을 마련하고 있다. 미국은 법무부와 국무부 산하의 글로벌 참여 센터(GEC)를 통해 외국의 허위 정보 확산을 방지하기 위한 조치를 취하고 있으며, 유럽연합(EU)은 디지털 서비스 법(DSA)을 시행하여 불법 콘텐츠와 허위 정보의 확산을 방지하는 규제를 강화하고 있다. 또한, 싱가포르는 온라인 허위 및 조작 방지법(POFMA)을 통해 허위 정보의 삭제와 정정을 강제할 수 있는 법적 권한을 확보했다.

전문가들은 댓글 로봇을 통한 여론 호도 문제가 더욱 심화될 것이라고 경고하고 있다. 특히 AI 기술이 발전하면서, 자동화된 댓글의 문맥 파악과 자연스러운 문장 구성이 가능해지며 탐지가 점점 어려워지고 있다는 점도 문제로 지적된다.

이에 플랫폼 운영자들과 정부는 댓글 로봇에 의한 여론 조작을 방지하기 위해 기술적 탐지 시스템을 강화하고, 이용자들 또한 온라인상의 정보 출처를 비판적으로 분석할 수 있는 미디어 리터러시 교육을 강화할 필요가 있다. 댓글 로봇에 의한 여론 조작이 사회적 신뢰를 훼손하는 심각한 문제로 부상하는 만큼, 계속해서 이에 상응하는 강력한 대응책이 요구된다.